|

|

|||||||

|

|

Опции темы |

Рейтинг:

|

Опции просмотра |

|

|

#11 |

|

Пользователь

Регистрация: 01.12.2016

Сообщений: 241

Вы сказали Спасибо: 0

Поблагодарили 1 раз в 1 сообщении

Репутация: 10

|

22-й сборник рецептов. В нем мы разберемся, как проверять индексацию всех страниц сайта одновременно в нескольких поисковиках, научимся парсить данные по ссылкам из выдачи одним заданием и будем искать сабдомены на сайтах. Поехали!

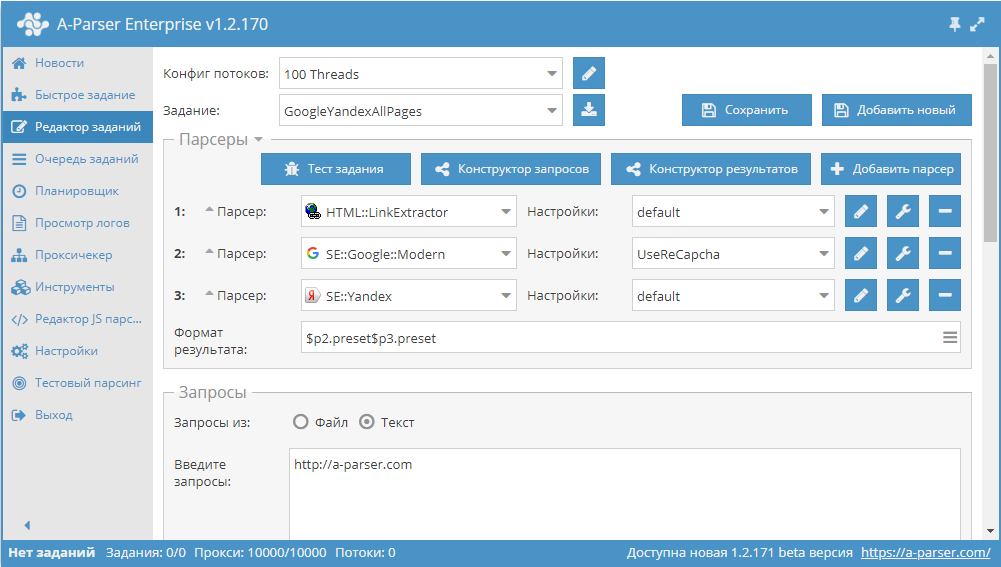

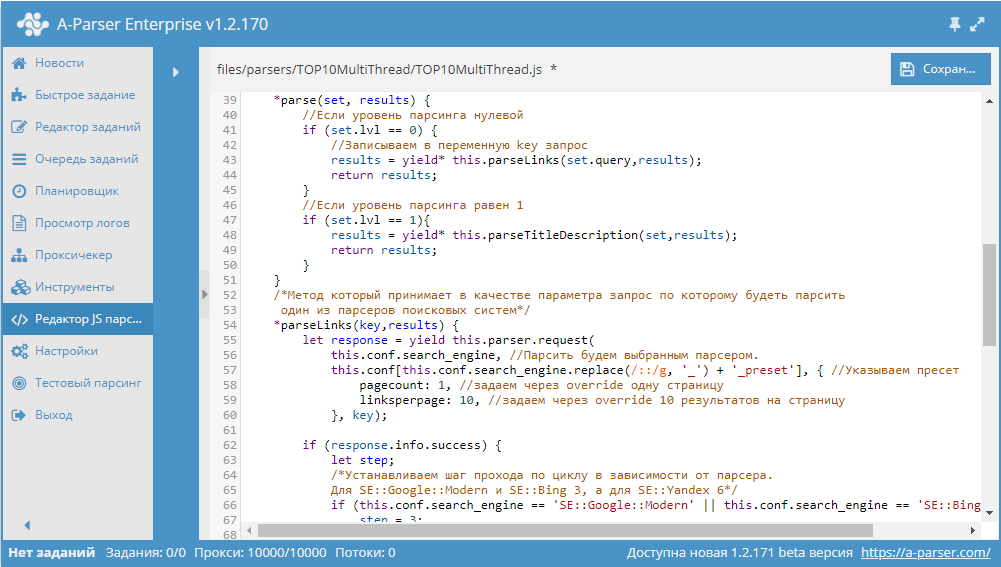

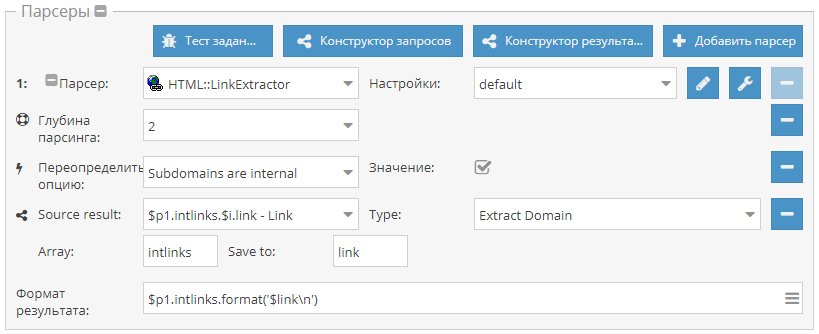

Получение страниц сайта и проверка индексации в Google и Яндекс[url=https://a-parser.com/resources/250/] Данный пресет позволяет спарсить ссылки на все страницы сайта и одновременно проверить их на предмет индексации поисковиками (в примере Google и Яндекс, можно по аналогии добавить другие ПС). Готовый пресет и описание по ссылке выше.  Парсим title и description для TOP10 поисковой выдачи по ключевому слову[url=https://a-parser.com/resources/263/] Пример использования tools.query.add в JavaScript парсерах. Данный парсер получает ссылки из выдачи, после чего собирает из каждой страницы title и description. И все это одним заданием с максимальной производительностью, благодаря многопоточному парсингу. Парсер с описанием доступны по ссылке выше.  Поиск сабдоменов сайта[url=https://a-parser.com/resources/235/] Небольшой пример, который демонстрирует, как собрать поддомены одного или нескольких сайтов. Используется HTML::LinkExtractor и Parse to level для прохода вглубь по страницам сайта. При этом Конструктором результатов извлекаются из внутренних ссылок домены и выводятся с уникализацией по строке. Готовый пресет - по ссылке выше.  Кроме этого:

Предлагайте ваши идеи для новых парсеров здесь[url=https://a-parser.com/threads/3464/], лучшие будут реализованы и опубликованы. Подписывайтесь на наш канал на Youtube[url=https://www.youtube.com/channel/UCvypGICrfCky8tPtebmIvQw] - там регулярно выкладываются видео с примерами использования A-Parser, а также следите за новостями в Twitter[url=https://twitter.com/a_parser]. Предыдущие сборники рецептов:

|

|

|

|