|

|

|||||||

|

|

|

Опции темы |

Рейтинг:

|

Опции просмотра |

|

|

#41 |

|

Пользователь

Регистрация: 01.12.2016

Сообщений: 215

Вы сказали Спасибо: 0

Поблагодарили 1 раз в 1 сообщении

Репутация: 10

|

Видео урок: Создание JS парсеров. Работа с ReCaptcha2(https://a-parser.com/threads/4493/)

Очередное видео в цикле уроков по созданию JavaScript парсеров. Здесь показано, как реализовать разгадывание рекаптч в JS парсере. В уроке рассмотрено:

Ссылки:

Оставляйте комментарии и подписывайтесь на наш канал на YouTube!(https://www.youtube.com/c/AParser_channel) |

|

|

|

|

|

#42 |

|

Пользователь

Регистрация: 01.12.2016

Сообщений: 215

Вы сказали Спасибо: 0

Поблагодарили 1 раз в 1 сообщении

Репутация: 10

|

Сборник рецептов #23: категории сайтов, парсинг в YML и преобразование дат [url=https://a-parser.com/threads/4517/]

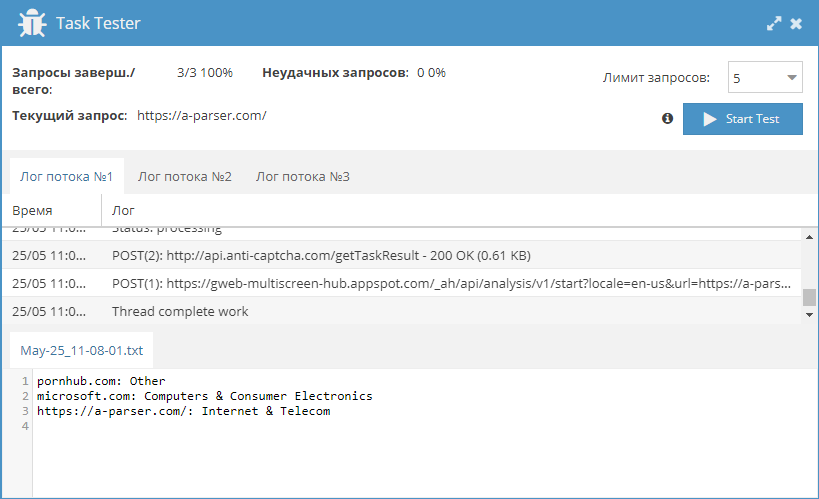

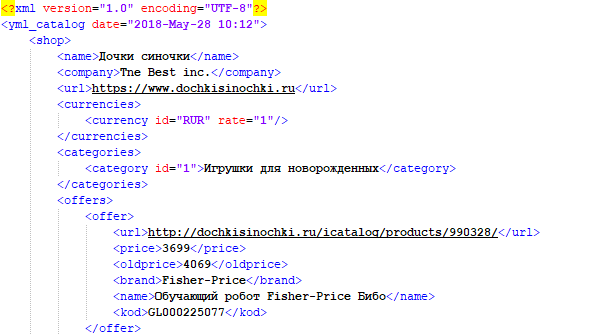

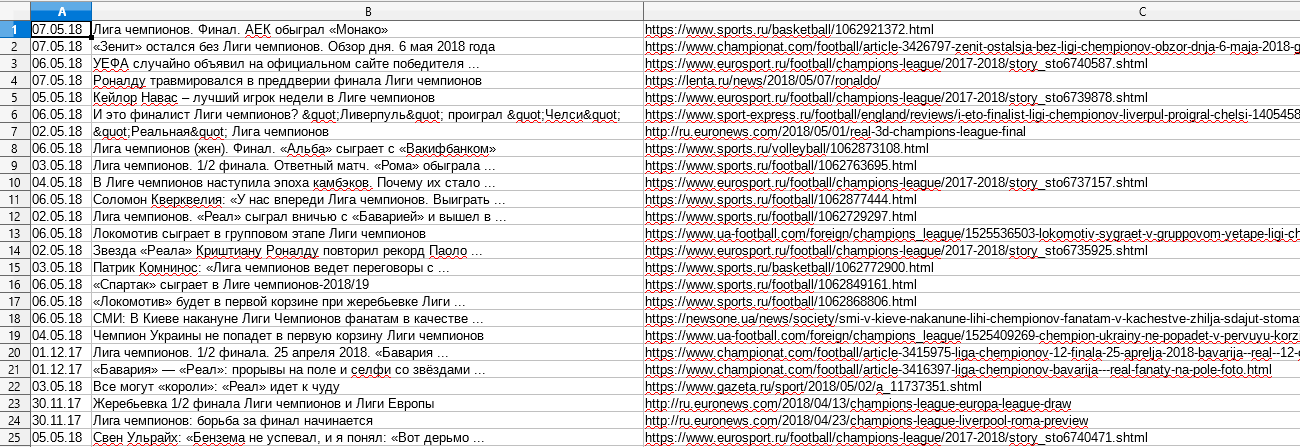

23-й сборник рецептов. В нем мы будем парсить категории сайтов из Google, научимся формировать файлы YML, а также разберемся, как парсить даты и преобразовывать их в единый формат. Поехали! Получение категорий сайтов из Google [url=https://a-parser.com/resources/285/] Категоризация сайтов - довольно актуальная задача, но существует немного сервисов, которые могут ее решить. Поэтому, по ссылке выше можно взять небольшой парсер, который позволяет получать категории сайтов из Google.  Выгрузка товаров в формате YML[url=https://a-parser.com/resources/284/] YML - это стандарт, разработанный Яндексом для работы с Маркетом. По своей сути, это файлы, схожие с XML, в которых содержится информация о товарах в интернет-магазине. Данный формат обеспечивает регулярное автоматическое обновление каталога на Яндекс.Маркет и позволяет отражать все актуальные изменения (наличие, цена, появление новых товаров). Пример парсинга интернет-магазина и сохранения собранных данных в YML можно посмотреть по ссылке выше.  Парсим Google новости с датой и преобразуем ее[url=https://a-parser.com/resources/281/] В поисковой выдаче Google возле новостей публикуется дата. Как правило, это могут быть метки "10 ч. назад" или "26 мая 2018 г.". Иногда может возникнуть задача спарсить все даты и привести их к единому виду. Как именно это сделать, можно узнать по ссылке выше.  Кроме этого:

Предлагайте ваши идеи для новых парсеров здесь, лучшие будут реализованы и опубликованы. [url=https://a-parser.com/threads/3464/] Подписывайтесь на Наш канал на Youtube [url=https://www.youtube.com/channel/UCvypGICrfCky8tPtebmIvQw] - там регулярно выкладываются видео с примерами использования A-Parser, а также следите за новостями в Twitter [url=https://twitter.com/a_parser]. Предыдущие сборники рецептов:

|

|

|

|

|

|

#43 |

|

Пользователь

Регистрация: 01.12.2016

Сообщений: 215

Вы сказали Спасибо: 0

Поблагодарили 1 раз в 1 сообщении

Репутация: 10

|

1.2.216 - улучшения в SE::Google::Modern и JS парсерах, а также множество других[https://a-parser.com/threads/4563/]

Улучшения

|

|

|

|

|

|

#44 |

|

Пользователь

Регистрация: 01.12.2016

Сообщений: 215

Вы сказали Спасибо: 0

Поблагодарили 1 раз в 1 сообщении

Репутация: 10

|

Сборник рецептов #24: уведомление в Telegram об экспайре доменов, чекер РКН и работа с SQLite [url=https://a-parser.com/threads/4591/]

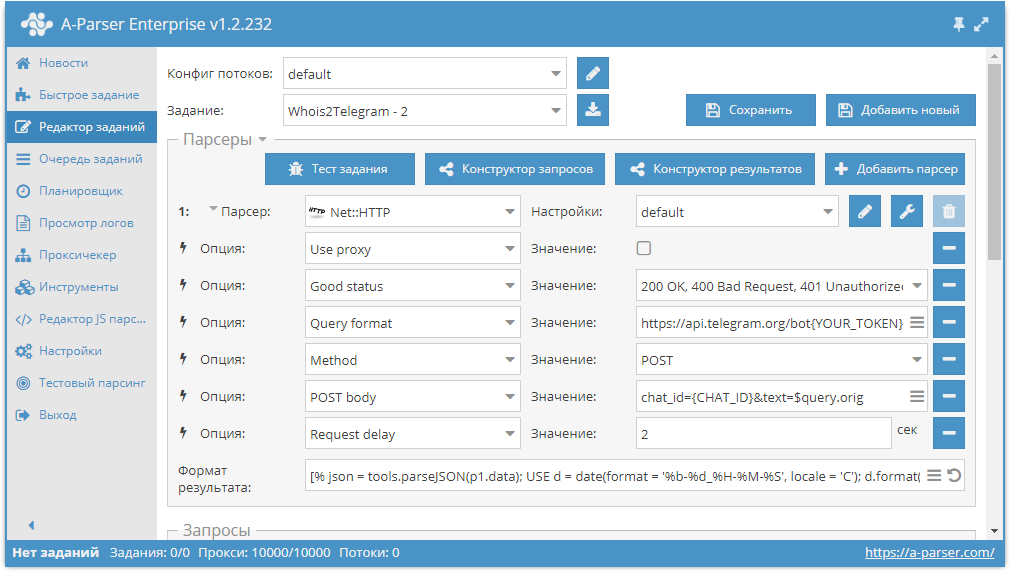

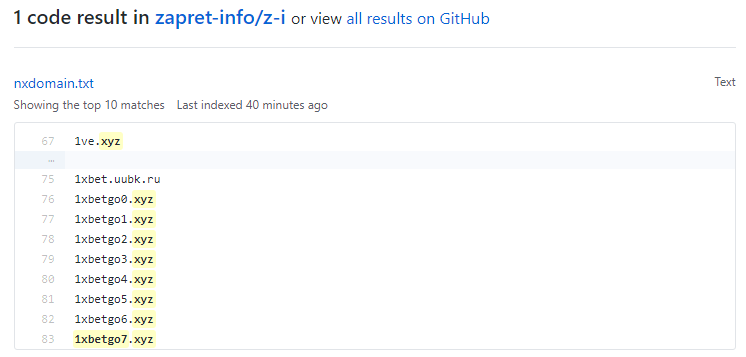

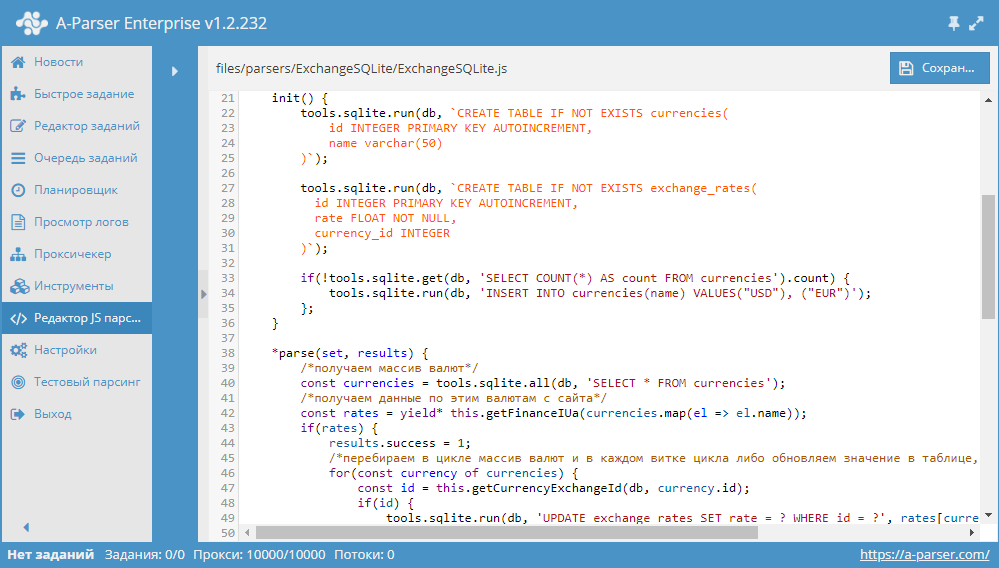

24-й сборник рецептов. В нем мы научимся мониторить окончание срока регистрации доменов с уведомлением в Телеграм, сделаем альтернативный чекер сайтов в базе РКН, а также на простом примере парсера курсов валют изучим работу с базами данных. Поехали! Получаем уведомления в Telegram об окончании срока регистрации доменов [url=https://a-parser.com/resources/287/] Мониторинг сроков регистрации доменов - это довольно распространенная задача. A-Parser позволяет легко автоматизировать этот процесс. Более того, можно настроить получение прямо в Телеграм уведомлений о доменах, срок регистрации которых скоро закончится. Готовое решение для автоматической проверки с уведомлением - по ссылке выше.  Проверка блокировки РосКомНадзора через GitHub [url=https://a-parser.com/resources/286/] В А-Парсере есть стандартный парсер Check::RosKomNadzor, который позволяет проверять наличие сайтов в базе РКН. Данные получаются напрямую из официального сервиса, для работы обязательно нужно подключать антигейт. Кроме того, официальный сервис РКН часто подвергается атакам, в связи с чем может быть недоступен. Но существуют альтернативные источники данных, доступность которых значительно выше и к тому же не требующие проверки в виде каптчи. Парсинг одного из таких источников и реализован в пресете по ссылке выше.  Простой парсер обменника с записью в БД SQLite [url=https://a-parser.com/resources/275/] Как известно, в A-Parser есть возможность чтения/записи данных в БД SQLite. В этом рецепте показано использование этого функционала на примере парсинга курсов валют. Готовый парсер доступен по ссылке выше.  Еще больше различных рецептов в нашем Каталоге [url=https://a-parser.com/resources/]! Предлагайте ваши идеи для новых парсеров здесь [url=https://a-parser.com/threads/3464/], лучшие будут реализованы и опубликованы. Подписывайтесь на наш канал на Youtube [url=https://www.youtube.com/channel/UCvypGICrfCky8tPtebmIvQw] - там регулярно выкладываются видео с примерами использования A-Parser, а также следите за новостями в Twitter [url=https://twitter.com/a_parser]. Предыдущие сборники рецептов:

|

|

|

|

|

|

#45 |

|

Пользователь

Регистрация: 01.12.2016

Сообщений: 215

Вы сказали Спасибо: 0

Поблагодарили 1 раз в 1 сообщении

Репутация: 10

|

1.2.246 - обновление базы Rank::CMS и новые функции в парсерах Baidu и MajesticSEO[url=https://a-parser.com/threads/4614/]

Улучшения

|

|

|

|

|

|

#46 |

|

Пользователь

Регистрация: 01.12.2016

Сообщений: 215

Вы сказали Спасибо: 0

Поблагодарили 1 раз в 1 сообщении

Репутация: 10

|

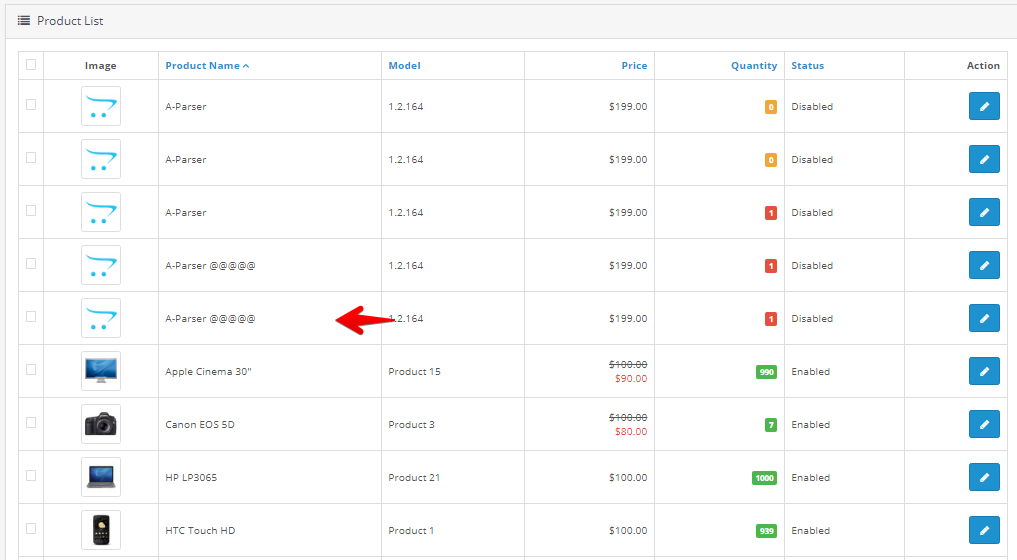

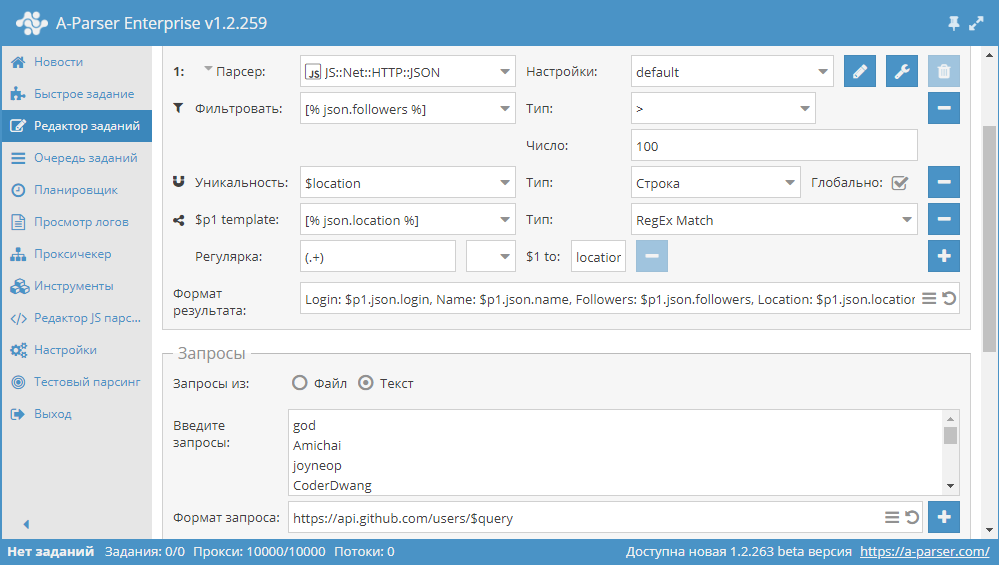

Сборник статей #4: добавление товаров в OpenCart и парсинг JSON(https://a-parser.com/threads/4647/)

В 4-м сборнике статей будет рассмотрено добавление товаров в OpenCart, а также описано создание универсального парсера JSON. В каждой статье приложены готовые JS парсеры, используя которые, можно на реальных примерах изучить описанные методы и поэксперементировать с ними. Поехали! Работаем с OpenCart. Часть 1. Вступление.(https://a-parser.com/resources/291/) Данная статья начинает цикл об одной из наиболее часто запрашиваемых возможностей - заливке товаров в интернет-магазин. A-Parser - это универсальный инструмент, который кроме прочего может решать и такие задачи. Для тестов выбран движок OpenCart, в 1-й статье будет рассмотрена авторизация, получение списка товаров и добавление товара. Подробности, а также пример парсера - по ссылке выше.  Парсинг JSON ответов и работа с их содержимым(https://a-parser.com/resources/289/) JSON - это довольно популярный способ предоставления данных, который, например, часто используется при работе с API различных сервисов. В А-Парсере есть встроенные инструменты для работы с ним, но не всегда их применение может быть простым, иногда требуется дополнительно писать сложные шаблоны, используя шаблонизатор. Поэтому в статье по ссылке выше будет рассказано, как написать простой универсальный парсер JSON.  Если вы хотите, чтобы мы более подробно раскрыли какой-то функционал парсера, у вас есть идеи для новых статей или вы желаете поделиться собственным опытом использования A-Parser (за небольшие плюшки  ) - отписывайтесь здесь(https://a-parser.com/threads/3464/). ) - отписывайтесь здесь(https://a-parser.com/threads/3464/).Подписывайтесь на наш канал на Youtube(http://www.youtube.com/c/AParser_channel) - там регулярно выкладываются видео с примерами использования A-Parser, а также следите за новостями в Twitter(http://www.youtube.com/c/AParser_channel). Предыдущие сборники статей

|

|

|

|

|

|

#47 |

|

Пользователь

Регистрация: 01.12.2016

Сообщений: 215

Вы сказали Спасибо: 0

Поблагодарили 1 раз в 1 сообщении

Репутация: 10

|

Видео урок: Создание JS парсеров. Работа с SQLite

Продолжение цикла уроков по созданию JavaScript парсеров. В этом видео показано, как работать с базой данных SQLite в JS парсере. В этом уроке рассмотрены: - Знакомство с языком запросов SQL - Создание простейшей базы данных SQLite при работе с JS-парсером - Получение и запись данных в базу SQLite при работе с JS-парсером Ссылки: - http://www.sql-tutorial.ru/ru/content.html - учебник по SQL - http://samoychiteli.ru/document29118.html - тоже учебник по SQL - https://finance.i.ua/converter/ - сайт, который использовался в качестве примера - https://a-parser.com/resources/276/ - статья и готовый парсер Оставляйте комментарии и [https://www.youtube.com/c/AParser_channel] подписывайтесь на наш канал на YouTube! |

|

|

|

|

|

#48 |

|

Пользователь

Регистрация: 01.12.2016

Сообщений: 215

Вы сказали Спасибо: 0

Поблагодарили 1 раз в 1 сообщении

Репутация: 10

|

[url=https://a-parser.com/threads/4688/]1.2.270 - новый парсер Rank::Curlie, множество доработок в Node.js функционале

Улучшения

|

|

|

|

|

|

#49 |

|

Пользователь

Регистрация: 01.12.2016

Сообщений: 215

Вы сказали Спасибо: 0

Поблагодарили 1 раз в 1 сообщении

Репутация: 10

|

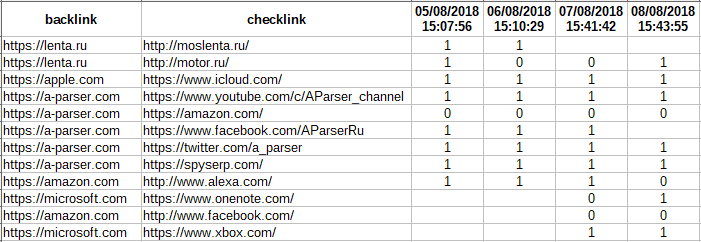

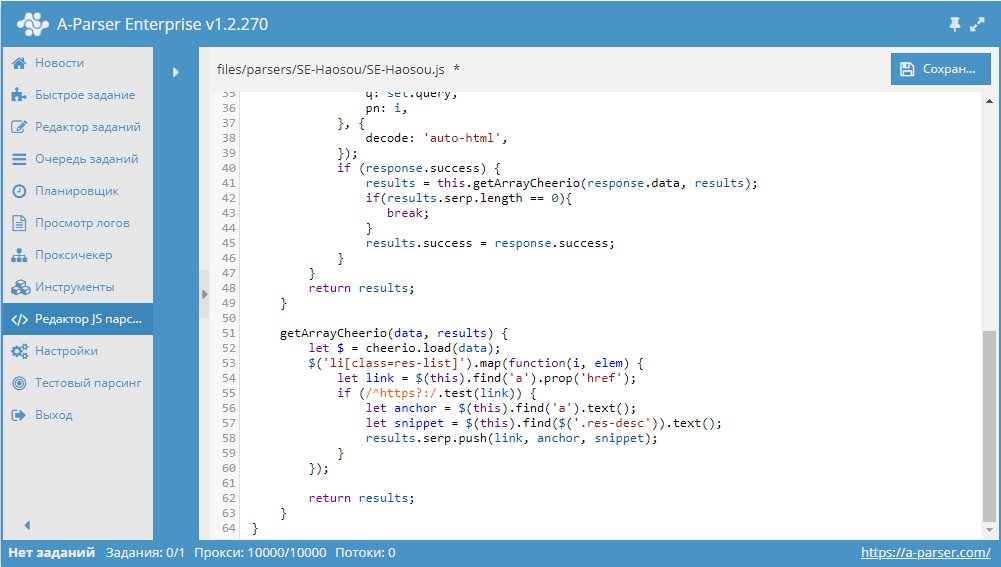

[url=https://a-parser.com/threads/4722/]25-й сборник рецептов

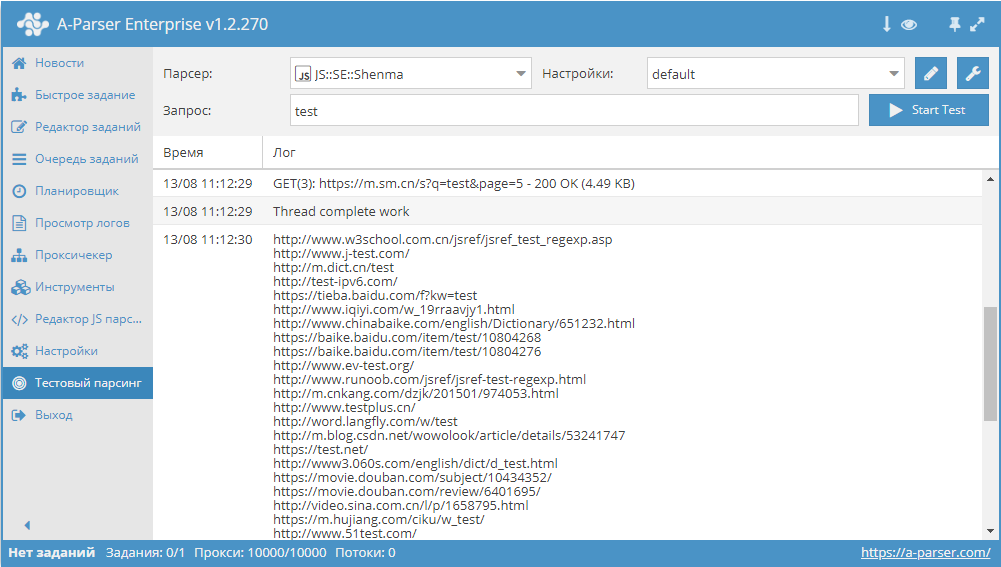

25-й сборник рецептов. В нем будет показан способ периодического парсинга с дозаписью результатов в таблицу, рассмотрен парсинг с помощью Node.js модуля Cheerio без использования регулярных выражений, а также показан парсер первой мобильной поисковой системы в Китае - Shenma. Поехали! [url=https://a-parser.com/resources/294/]Периодическая проверка обратных ссылок с дозаписью результатов в таблицу Пример решения одной из наиболее запрашиваемых задач - дозапись периодически получаемых результатов в одну и ту же таблицу. В качестве хранилища данных используется SQLite, при каждом запуске данные добавляются и выводятся в таблицу. Готовый пресет с комментариями - по ссылке выше.  [url=https://a-parser.com/resources/296/]Парсер поисковой системы Haosou Как известно, в основе почти любого парсера используются регулярные выражения, реже - XPath. Работа с этими методами требует определенных знаний, что в свою очередь может вызывать некоторые сложности. Поэтому существуют и другие методы. Использование одного из них на примере парсинга популярного в Китае поисковика Haosou, показано по ссылке выше.  [url=https://a-parser.com/resources/295/]Парсер китайского поисковика Shenma Еще один китайский поисковик в этом сборнике - Shenma. Это первая мобильная поисковая система в Китае, ориентирована в первую очередь на мобильные сайты. Пресет - по ссылке выше.  Еще больше различных рецептов в нашем [url=https://a-parser.com/resources/]Каталоге! Предлагайте ваши идеи для новых парсеров [url=https://a-parser.com/threads/3464/]здесь, лучшие будут реализованы и опубликованы. Подписывайтесь на [url=https://www.youtube.com/channel/UCvypGICrfCky8tPtebmIvQw]наш канал на Youtube - там регулярно выкладываются видео с примерами использования A-Parser, а также следите за новостями в [url=https://twitter.com/a_parser]Twitter Предыдущие сборники рецептов:

|

|

|

|

|

|

#50 |

|

Пользователь

Регистрация: 01.12.2016

Сообщений: 215

Вы сказали Спасибо: 0

Поблагодарили 1 раз в 1 сообщении

Репутация: 10

|

Видео урок: Создание JS парсеров. Реализация подстановки запросов и их многопоточной обработки.(https://a-parser.com/threads/4738/)

Продолжение цикла уроков по созданию JavaScript парсеров. В этом видео будет показано, как "на лету" добавлять запросы в задание и многопоточно их обрабатывать. В одной из наших статей(https://a-parser.com/resources/261/) мы рассмотрели способ разработки парсера, который собирает ТОП 10 из выдачи поисковика, а затем по очереди парсит нужные данные по полученным ссылкам. Вроде все неплохо, но если у вас не 10 запросов, несколько тысяч? Задание будет выполняться очень долго, а время это самый драгоценный и не восполняемый ресурс. К счастью в A-Parser есть такая замечательная вещь, как многоуровневый парсинг, который позволяет многократно увеличить скорость парсинга, и в этом видео мы рассмотрим как этой возможностью пользоваться. В этом уроке рассмотрено:

|

|

|

|